|

8 Z7 w/ e. h0 l- f$ J0 I6 V. w! j

原标题:声声声声临其境,一起坠入阿里云超音感空间 * c; \6 X& _3 j5 v% @2 C+ i* D+ n

' [! I' I: p* X/ S1 X1 t& h2 O; f) t2 W8 } c6 K! L4 `( x; O

, e4 ^( A& b4 u9 U

大众对沉浸体验的追求,不再仅局限于“视觉”。声之切,境尤升。

3 V9 {6 m4 v: T+ v/ x2 O' Q* M) ^4 E! S$ y- @' f2 s R

. i. }6 w( ^; c: k( Z' z4 z6 G

随着硬件技术的升级、软件内容的丰富以及5G网络环境的优化,推动几经浮沉的VR产业走向正循环。

" `9 Q+ f( n" r2 ?+ y 就在去年,「Roblox上市」、「Facebook更名为Meta」、「微软收购暴雪」等将元宇宙相关产业推向风口,而Oculus Quest 2(VR一体机)出货量破千万台的成绩,更是一件将沉浸式VR从概念落地场景实践的标志性事件。 + m& l! S+ N6 _0 w ?

在本次云栖大会阿里云视频云的8K VR视频技术展台,体验者通过佩戴Pico VR头显,感受清晰度高达8K的360度VR视频,实时捕捉超高清细节。

2 |$ f% ?2 c3 j5 {' Z 不仅如此,体验者还能以“声”临其境,感受令人惊艳的全景声技术带来的沉浸式视听体验。 7 l9 v8 a& I; X& K6 G+ W5 e

^8 R% m% F6 W* X& o6 t8 h. P

, `( H) R% D$ p- l 01“视”之外的沉浸之“声”8 u) c3 d. R; @

「沉浸式视听体验」一词已多次出现在大众视野,究竟什么是沉浸式视听体验呢?

" F" l3 P1 R) Z$ O" O& }5 G3 S “沉浸式视听体验”是指通过视频、音频及特效系统,构建大视角、高画质、三维声特性,从而具备画面包围和声音环绕的主观感受特征,观众在所处位置就能获得周围多方位的视觉、听觉信息,带来身临其境之感。 7 M/ j; m/ I5 ]7 B

听觉作为仅次于视觉的重要感官通道,对沉浸式的视听体验至关重要。随着用户对视听体验的极致追求,在“视”之外,沉浸之“声”技术应运而生。

0 }% ~8 }! J" o8 ^- i1 Q' k6 J 「沉浸式音频」是指能够呈现空间的还音系统的声辐射,至少能覆盖观众的前、后、左、右、上五个方位。除此之外,还能真实地营造出声场的水平纵深和垂直高度,即从听者角度能精准地定位声音的方向和位置。

" A. b4 n$ A$ _! c5 O 从技术角度是如何实现呢?

, o0 P( u* {: ~4 X 其实,真实世界的声音来自环境的四面八方,人耳往往可以通过声波的时间差、强度差、相位差、频率差等辨别声音的方位。 - [* N7 \' T. J8 q$ Y

但现有的立体声和5.1环绕声只能呈现部分方向传来的声音信息,若想获得声音带来的沉浸感,需要尽可能全方位再现真实世界的声音,也需要一种沉浸式音频技术来实现。 1 H! [7 c9 G [ q' I! n: w' H- S

图片来源于网络 图片来源于网络

, a" Y7 h" q) `8 \% e! G 02一个「球面」的声场?

3 g! J8 g5 ^5 E 沉浸式音频主要技术有三大类: 基于声道 Channel Based Audio(CBA)、基于对象Object Based Audio (OBA)、基于场景 Scene Based Audio(SBA)。 1 n5 T) y: }' a0 b

❖ 基于声道技术(CBA):在传统 5.1 环绕声的基础上,增加了 4 个顶部声道,通过增加声道的方式来补充空间中的声音信息,但只能呈现部分方向来的声音信息。 3 G) ~4 W2 C3 Y# {4 Q& y: _6 V

❖ 基于对象的技术(OBA):是目前主流技术,并在电影领域已广泛应用,如 Dolby Atmos 全景声。该技术会产生大量的数据和运算,除了声道的音频外,还有关于声源的元数据Metadata,即:声源(位置/大小/速度/形状等属性)、声源所在的环境(混响Reverb/回声Reflection/衰减Attenuate/几何形态等),该技术在VR领域只适合主机VR上的大型游戏,对于普通移动端的硬件设备来讲,算力及带宽承载具有较大压力。

( ]3 e) q- ~ q6 r7 B5 o0 E c ❖ 基于场景的技术(SBA):用来描述场景的声场,其核心的底层算法是Ambisonics 技术,可被映射到任意扬声器布局中。Ambisonics技术的特点是:声源贴在提前渲染好的全景球上,即所有声源将被压缩在了这个球上。

1 a( W+ ?' F/ ~$ Z W- O  图片来源于网络 图片来源于网络

, a V6 n3 N& j! D8 R

本文的音频体验展示便采用了Ambisonics的录制格式(文末体验DEMO)。 ) {; {* A( e1 d: ~8 x

Ambisonics作为全景声的一种录取格式,在上世纪70年代就已经问世,但一直没有获得商业上的成功。

: O1 W' k6 o- D. v 随着近几年VR,AR等相关领域的兴起,Ambisonics开始逐渐被讨论。与其它多声道环绕声格式不同,Ambisonics传输通道不带扬声器信号,允许音频工作者根据声源方向而不是扬声器的位置来思考设计,并且为听众提供了用于播放扬声器的布局和数量,因此,大大增加了灵活性。

+ b" e' ]- w) r6 b" [ Ambisonics音频格式可以解码任何扬声器阵列,并且可以完整地、不间断地还原音源而不受任何特定编解码播放系统的限制。

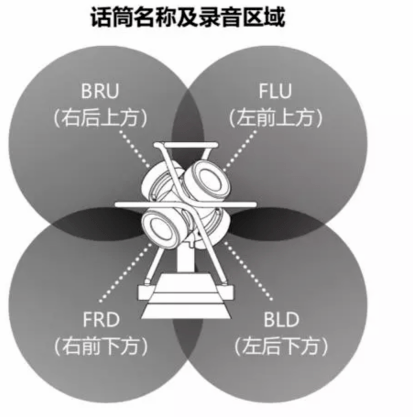

" g2 C% W9 }( g1 m4 A' J& j 下图是一个一阶的Ambisonics结构,4个MIC垂直部署在一个四面体上,播放效果与Dolby Atmos类似,但和Dolby Atmos不同的地方是:Dolby Atmos 只解决了半球的声场。

5 A2 D" \9 V# D 而Ambisonics除了水平环绕声音,还可以支持拾音位置或者听众上下的声源,即整个球面的声场。 & a! e# H7 ?, A6 l( V. G

' `9 Q1 Z* m% V. H1 }, X" n2 j  图片来源于网络 图片来源于网络

( c F5 ^/ s7 F

03实现声声入耳的引擎:AliBiAudio

- c+ [. a- E/ H+ y! F 全景声不仅仅是增加几个声道那么简单,而是把整个声音系统架构都颠覆了,从之前基于声道来混音的技术上升为基于对象的音频处理技术,使人在环境中的听觉感受与现场实际声音一致。 , o$ `; O- j; X7 W( M

将全景声音频重建成用户可测听的形式有两种途径,一种是多扬声器重建,即电影院或家庭影院中的音响系统,其本质是将全景声音频转换到5.1.4或7.1.4格式;另一种是耳机重建,即将全景声音频通过双耳渲染技术转换为双声道音频,并保留其全部空间信息。 ! e d1 b1 J) e+ N9 `

相对于多扬声器重建,耳机重建成本低、易部署、效果好。 + b3 d5 l/ D) W! \1 {9 E2 V! @& e

不言而喻,耳机重建全景声音频,需要一个双耳渲染的过程,以此来通过两个立体声通道创建空间和维度的听觉感知效果。

. H+ g- L- a& {6 \- S. C7 a

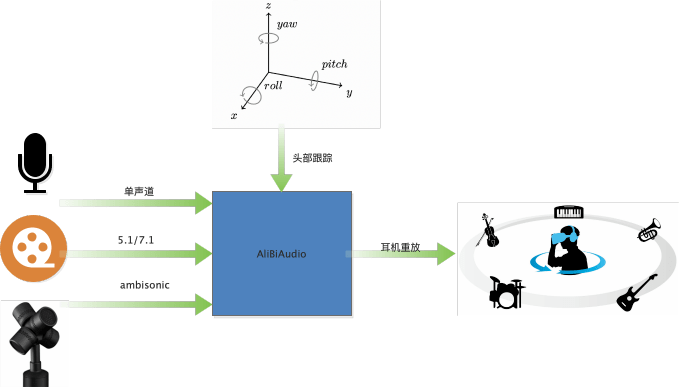

5 \; @4 A+ I& o0 |3 T AliBiAudio 就是一个阿里自研的双耳实时渲染引擎,结合头部跟踪坐标,可以达到人转动,声源位置不动的效果。当前双耳渲染引擎,具有支持全平台、多场景、易部署等特性。该引擎既可以部署在移动端,也可以部署在云端,并支持三大场景的渲染。

( r" c9 s+ p @2 Q2 o0 \3 d3 D' [ ❖ 单声道输入:用于虚拟会议场景,可将不同位置的人,渲染在不同的角度发声,通常部署在服务端。 2 @0 c2 m( f5 S' m$ ?+ V7 |

❖ 5.1/7.1 输入:用于影视剧渲染,得到更逼真的环绕声,类似优酷中的“帧享”音效。既可以部署在端上(如:Apple Music 空间音频),也可以部署在服务器上(如:作为媒体处理,将多声道数据下混成2路数据)。

2 T* ` i! J4 q) A: y ❖ Ambisonics输入:对Ambisonics格式进行渲染,用于VR直播,VR点播,当前部署在Aliplay中。 5 h& Z# m+ E( [$ A- U: L% S3 w

2 ?0 p/ }% z4 u: _0 U6 X% T5 _ 04如何让声音跟随脑袋一起摇摆

) R* ~) `" y/ x! l; M' o ❖ HRTF ! I+ i% c1 _+ D- t6 d

双耳渲染引擎的核心模块是人头传递函数HRTF( Head-related Transfer Function )。

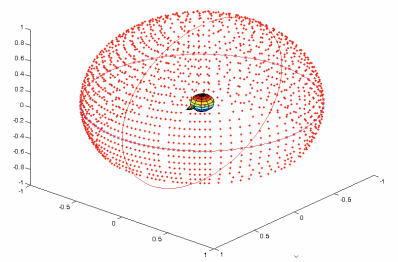

5 a) \! B3 Z+ d. ? 每一方向都有两个HRTF,分别代表音源到左右耳的房间冲击响应,通过720度扫描可以得到一个球形的HRTF库,如下图是一个ARI HRTF 数据库的分布。 * T `/ c) v, a

! a3 u) R0 ?' _ I( g

ARI HRTF 数据库

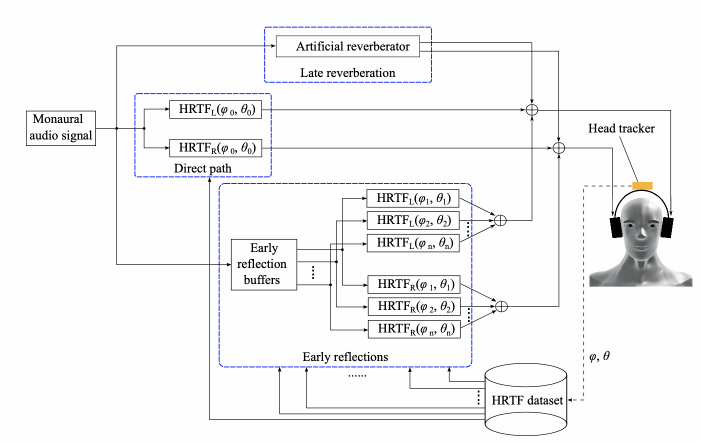

/ `5 _/ c9 t3 \. s8 u" k( R& H1 U 在渲染时,通过输入的角度信息,先从数据库中选出当前角度的HRTF对。然后再将输入数据分别和HRTF对进行卷积得到左右耳信号。为了得到更逼真效果,还可以添加一定量的房间混响如下图所示:

+ n: v/ |: n) R! R' H0 a' M/ h

( o. g1 Z( y0 s! ?8 W! B' }; m

本项目对大量HRTF库进行筛选,获取到一个最优的数据库。

7 I( `5 {8 A" q% ~5 J ❖ Ambisonics数据格式

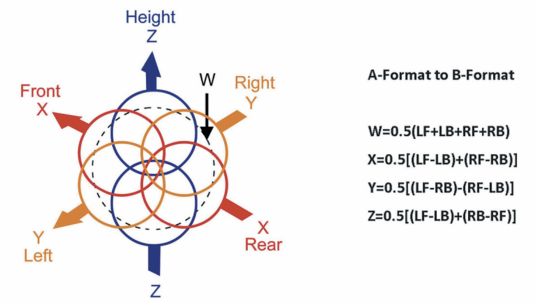

9 y! Y* L. I9 S% ]) | D Ambisonics 的基础功能是让来自不同方向点声源,作为360度的球面来处理,这个中心点,就是麦克风放的位置。当前广泛用于VR 和 360 度全景视频的Ambisonics 格式,是一个叫做Ambisonics B-format的4声道(还有另一种格式叫A-format)。由W, X, Y and Z组成。对应着360度球面的,中心,左右,前后,上下。

* S, t3 K" q# ]! s4 V1 v5 q

! l. L$ l: k4 t0 Q2 ^ W 是一个全向' {/ f+ d2 t$ O" F& Z

X 是一个双极 8 字指向,代表前后$ u- U* l! x! C4 {; ?, q

Y 是一个双极 8 字指向,代表左右

9 n7 M9 V" m. h2 v- q" U Z 是一个双极 8 字指向,代表上下. @# q9 e% L/ o8 f) F" I3 n

! V2 S) p! k( e4 a) _; K% B% M f/ a$ } B-format 有两种格式分别是ambix 和fuma(它们只是排列顺序不同),而A-format 代表4个mic 采集的原始数据。B-format和A-format的关系如下: ( [0 k `6 H+ X7 b9 c5 u% _8 p

图片来源于网络 图片来源于网络

# `5 O6 B0 ~) z# Z0 W

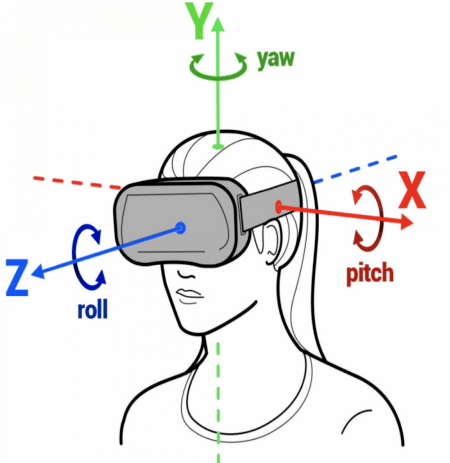

❖ 头部跟踪

9 L5 ?( r/ p7 w2 `" Z0 j7 h5 J, A 该技术利用了某些特定款式耳机中的传感器信息,如:加速度计和陀螺仪,从而更好地跟踪头部运动,并做出相应的音频调整。

0 w3 f" V1 Z; B; F Apple已经从 iOS 15 开始通过兼容耳机带来支持头部跟踪的空间音频功能,目前Android 13的发布预览版已完全支持在兼容设备上使用头部跟踪的空间音频。本次云栖大会的展台体验便主要利用了Pico头显设备中陀螺仪的信息。 5 A7 d: I$ _8 S

图片来源于网络 图片来源于网络

% W% Z6 r7 L: c; ] 05一起「声」临其境

3 n! l& e6 b' j# y o 「佩戴耳机」体验全景声,效果更好哦!

3 L7 R4 y( I! K2 Y% O; L$ y% Y 现场体验中,声音的变化会随着头部的转动而转动,本次线上DEMO体验将依靠手动界面移动来模拟头部转动。

& r% E- Z1 w) v 01听:无人机掠过头顶

) V6 w8 I& B- Q$ p0 [( Q$ I! N3 e' I. O. y# n0 f/ f2 S1 D

无人机逐渐升起从头顶掠过,当视角跟随(模拟)无人机时,声音相应地实时变化。

& _+ X9 H' ~, @9 m/ X/ V 02听:滴答滴答 # E$ Y2 c+ I! ?7 A3 I p

" @8 ]* B: ^& _3 v# t 聆听水滴的同时,发现左方有无人机的声音,视角随声而转,一路跟随,感受无人机由近及远的变化。 % ?0 c) v, p' w" A$ V

03听:沉浸游园 . j9 W* M G# U2 y0 A" ] @$ Z: J$ T

" w. s$ C0 q& }! r

主持人在介绍园区时,用户向四周左右观看(模拟),在此过程中,主持人的声音呈现与他在你视角的位置始终保持对应。

3 m G& P/ I9 J: ]) F" l9 R) h 04听:PING PANG之声

; N" G) w2 Z; v" d2 x1 K- q1 O# F4 z; p( ^* {, F/ b

沉浸式场景怎能少了运动!一转头,乒乓之声已被“抛之脑后”。

; x; ^. T. a7 Z6 |8 r+ G( s4 m# C 06音频的未来,炫到无法想象

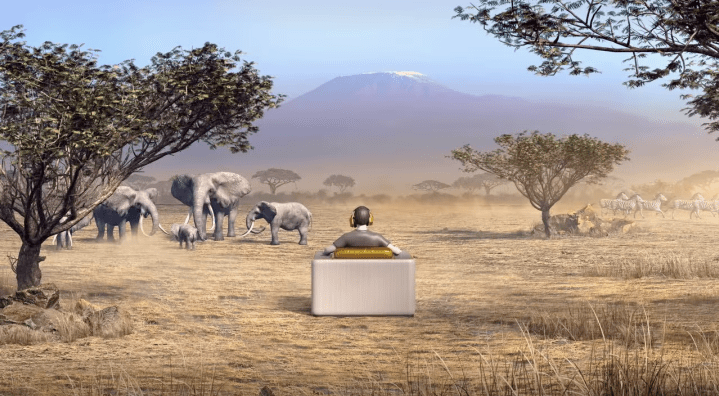

7 H$ X# B* d2 Z 除此之外,全景声双耳渲染技术还可运用于多个场景,带来沉浸视听的无限想象力。 ) x. Q/ N* E+ g. x, q

❖ VR演唱会 " O- i/ L5 V3 v, Q6 j% c

现场混合360度视频和全景声音频, 同时将数据传输到相应的移动平台,并进行实时直播。让观众可以达到“不在现场,胜似现场”的感觉。 9 H" Q+ |) p' Z! s% ^9 T

- ]' I+ J/ f1 X5 a

❖ 沉浸式影院 , X4 D& j7 w7 c& d$ \% T

也可以称之为沉浸式投影,是一种成熟的高度沉浸式虚拟现实系统。它将高分辨率的立体投影技术、三维计算机图形技术和音响技术等有机地结合在一起,产生一个完全沉浸式的虚拟环境,大大增加观影的沉浸感。 ) W- A/ S: p6 Z8 N) m: u% I

❖ 智慧教育

7 c9 s7 }$ h# H 沉浸式教学模式逐渐受到教育界的关注。例如,IBM研究院和伦斯勒理工学院联合开发的“认知沉浸室 ”,它能让学生置身于中国的餐馆、商场、园林等虚拟场景,与AI机器人练习汉语对话,大大提升了学生的学习兴趣和专注力。

* y, V1 J. {, }% j& H6 `, k ❖ 虚拟会议 # [2 B" V+ i4 M: s

以Facebook基于VR开发的虚拟会议为例。而为了更贴近现实,Workrooms还加入了沉浸音频功能,让用户交谈时,声音的发出的方向跟他们所处的房间位置一致,从而进一步增加参会者的沉浸感。 / [$ q `/ G/ C

图片来源于网络 2 V# }0 ^' M& n o! w9 U

未来的沉浸音频技术将如何发展? " n7 M8 s3 A3 O7 a" y% Y

以双耳渲染引擎的核心模块HRTF为例来说,当前的HRTF模型,是一个固定模型,无法适应不同人的声音感知差异,尤其在正前方的外化能力还不够好。若想得到更逼真的声音效果,需对HRTF进行进一步优化,使其适应每个人的个体差异性。

7 n" ?0 w( g$ P! P! U$ [ 比如:根据每个人的人头大小,耳廓信息以及肩膀的形状独立建模。在国外HRTF的建模与个性化发展已经成为趋势:

# {8 o( x. `: R, y# e; U. q% r 3月开始,杜比支持个性化HRTF的定制。

; L' o' Z& I% i% d! [ 图片来源于网络

6 y' ]0 B. D) D- k 9月开始,iPhone升级了ios16,通过人脸扫描,可以定制自己的HRTF。

. ^0 y5 S% ]( l- {% p2 _ 图片来源于网络

; l* a8 y8 T- H5 A 此外,用机器学习的方法,将面部,耳部图片,转化成HRTF也在火热研究中。 $ O- M; V/ a0 M5 `% N+ f+ i

未来,阿里云视频云将继续探索基于深度学习与信号处理的的音频技术,为VR超高清视频直播带来以「声」临其境的超沉浸之感。 $ r. l0 P- y0 w

参考文献: + K$ [7 v2 i0 O- |

[1] 5G 高新视频—沉浸式视频技术白皮书

9 k' f; ]1 e/ i1 M2 ]- o0 a o [2] https://m.fx361.com/news/2018/0326/3298705.html / L' W# v+ M( N9 T. @4 E* E

[3] https://3g.163.com/dy/article/ELBCI2OG053290QL.html?clickfrom=subscribe

2 L2 d* q2 U' |$ c [4] https://www.birtv.com/Magazine/content/?246.html - `4 P E: I4 c" A4 e

[5] https://m.midifan.com/article_body.php?id=6201

, _, e! w- B) |# h* i [6] https://sound.media.mit.edu/resources/KEMAR.html

: A$ k" u7 y( T5 [7 Z' w [7] https://juiwang.com/assets/projects/hrtf_nn_bem/hrtf_nn_bem.pdf 5 w0 i. m+ u5 {& W7 y8 u; P/ p

[8] https://www.tvoao.com/a/208656.aspx返回搜狐,查看更多

- @6 }7 c. p' \6 J& `3 y( \- s. K! s

责任编辑:

. c) F6 W: l4 m- U( l; J1 D1 z8 g5 C: v% Z8 e0 f5 g6 Y

# N @+ z- `. O; z- a

3 M A& j' F: Q0 }

2 x3 \0 E t" I& H( a: Y |